Ученик е вървял по коридора, „държейки музикален инструмент по начин, който е бил интерпретиран като оръжие“, което е активирало протокола за сигурност.

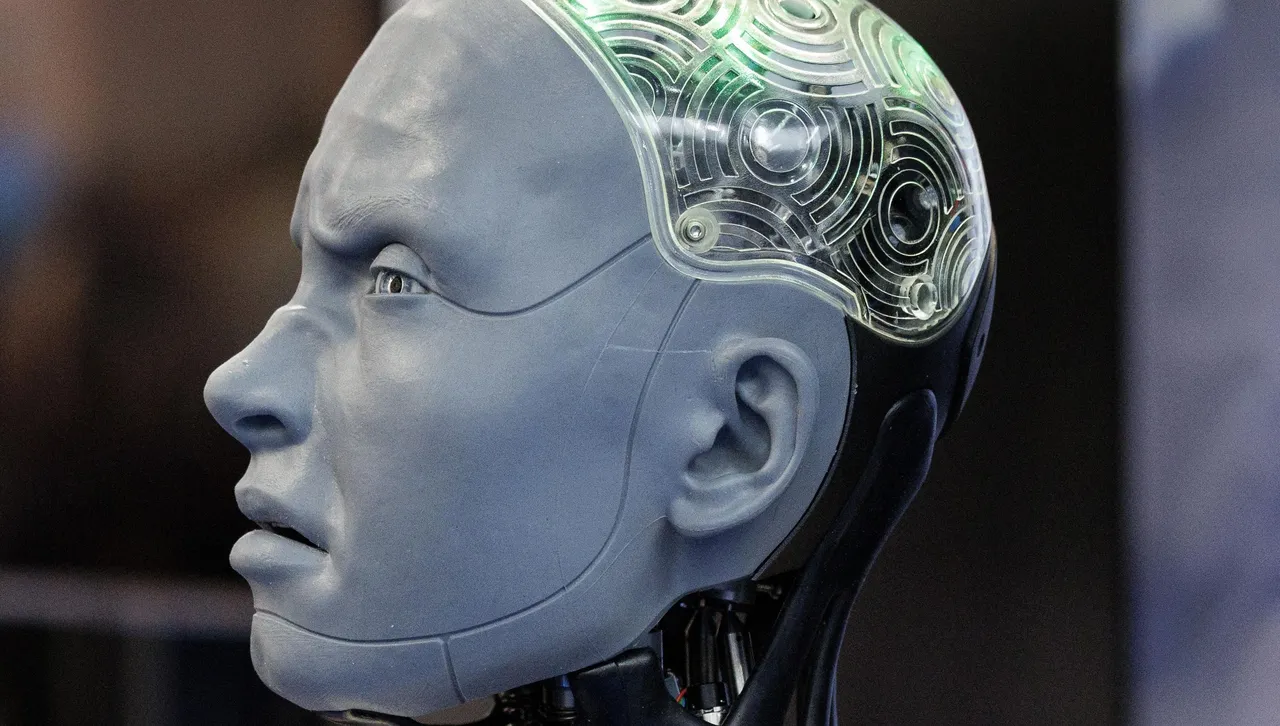

Учители и ученици в основното училище "Lawton Chiles" във Флорида изпаднали в паника през миналата седмица, след като система за видеонаблюдение с изкуствен интелект засякла „ученик с огнестрелно оръжие“.

Оказало се обаче, че „оръжието“ всъщност е кларинет, носен от ученик от училищния оркестър.

Сигналът автоматично е задействал т. нар. „код червено“, което е принудило училищната администрация незабавно да реагира на решението на системата. По-късно полицията е отменила мерките и е уверила, че не е имало реална опасност.

В съобщение до родителите директорката на училището д-р Мелиса Лаудани посочва, че районът разполага с „множество нива на училищна сигурност, включително автоматизирана система за откриване на потенциални заплахи“. По думите ѝ ученикът е вървял по коридора, „държейки музикален инструмент по начин, който е бил интерпретиран като оръжие“, което е активирало протокола за сигурност.

Не е ясно каква точно система за наблюдение използва училището, но фактът, че тя не е успяла да различи кларинет от огнестрелно оръжие, предизвика сериозни въпроси.

Случаят във Флорида идва малко след друг подобен инцидент в Балтимор, при който 16-годишен ученик беше задържан с насочени оръжия от полицията, след като изкуствен интелект объркал малък пакет чипс „Доритос“ с пистолет. И в двата случая липсата на човешка проверка на сигнала е довела до прекомерна и потенциално опасна реакция.

Компанията Omniilert, чиято система стои зад инцидента в Балтимор, заяви, че технологията е „функционирала по предназначение“, като целта е била бърза реакция за гарантиране на сигурността.

Случаите обаче показват колко критично важно е подобни системи да бъдат надеждно тествани и да работят с реален човешки надзор, преди да бъдат внедрявани в училищата. При разпознаването на потенциални заплахи фалшивите сигнали може да бъдат също толкова опасни, колкото и пропуснатите реални рискове.

Още от Свят

Агенция „Тасним“: Иран прекрати преговорите със САЩ

Според Техеран има нарушения „на всички фронтове“ на иранско-американското примирие

Иран обеща свободно преминаване на японски кораби през Ормуз

„Ще се постараем да осигурим безпроблемно и лесно преминаване на японските кораби.“

Фабрика за фойерверки експлодира в Малта - ударната вълна изпочупи прозорци на километри от взрива

"Никога през живота си не съм бил толкова уплашен — за миг наистина си помислих, че сме под бомбардировка.“